„Nichts ist so beständig wie der Wandel.“...

mehr lesen

OOP 2024 – wir sind dabei!

Es ist gut, unseren Geist gegen den von anderen...

Requirements for Software Architects

Herzlich Willkommen zum letzten Teil...

Requirements for Software Architects

Willkommen zurück zum zweiten...

Requirements for Software Architects

Herzlich Willkommen zu unserer...

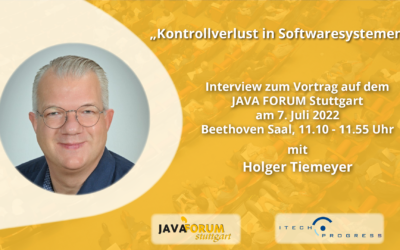

Kontrollverlust in Softwaresystemen?

Im Rahmen des Java Forums in Stuttgart am...

DevSecOps – sichere Softwareentwicklung und Betrieb

In einem agilen Umfeld nach DevOps-Ansatz wird...

DevOps als Unternehmens-Kultur verändert die agile Software-Entwicklung

Nach einer Entwicklungsphase jeder Software geht...

Native Cloud Application (NCA) – Entwicklung unter den Wolken

Waldemar Artes hat langjährige Erfahrung als...

ITech Academy stellt 10 neue Trainings vor!

Neue Trainings in den Bereichen:...